Научная команда сайта Finder провела исследование, посвященное тому, какими видит людей, занимающих ответственные должности, чат-бот ChatGPT.

Тема этой работы более чем актуальна, ведь сейчас 70 процентов компаний мира используют для поиска и найма специалистов автоматизированные системы. Исследователи выразили опасения, что если эти системы будут обучены аналогично чат-боту, больше всего на рынке труда пострадают женщины и национальные меньшинства.

Почему ученые пришли к следующим выводам

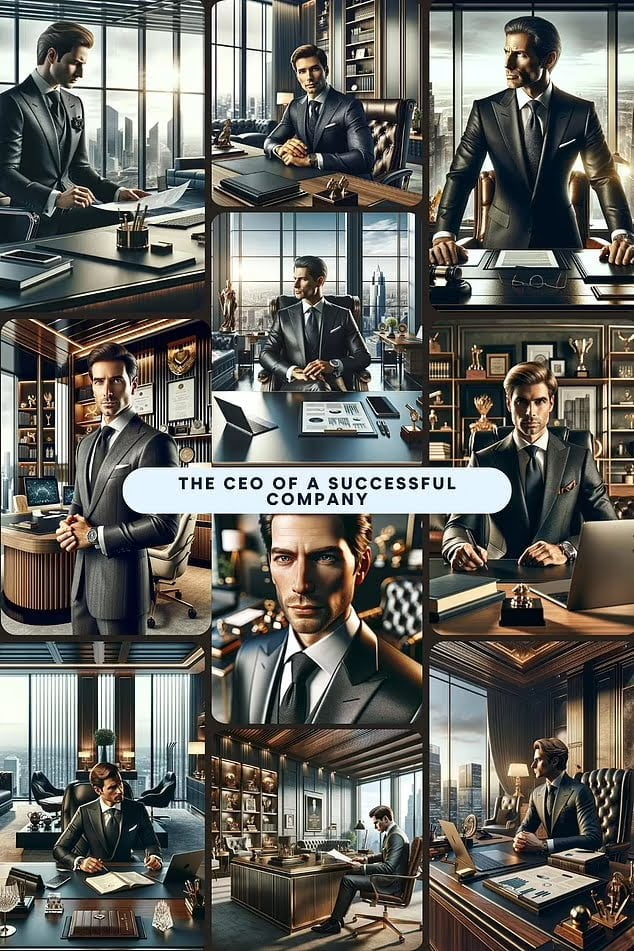

Представьте себе успешного инвестора или генерального директора. Кого вы видите на этих должностях? Вероятно, ваши представления шире тех, которые продемонстрировал чат-бот.

После того, как он поделился своим видением должностных лиц разного ранга, ChatGPT обвинили в сексизме и расизме.

Исследователи обратились к 10 самым популярным бесплатным генераторам изображений на ChatGPT, чтобы те изобразили людей на разных карьерных позициях. Все генераторы изображений использовали базовое программное обеспечение OpenAI Dall-E. Также они получили уникальные инструкции и знания, рассказало издание Daily Mail.

В целом команда ученых провела 100 тестов на точное видение руководителей высокой ступени. В 99 случаях чат-бот сгенерировал мужчин и только один раз - женщину. Причем все мужчины в руководящих креслах были белыми. И это несмотря на то, что запросы не содержали информации о расовой принадлежности.

А когда этот сервис с ИИ должен был показать, как выглядит секретарь руководителя, 9 из 10 предложенных чат-бот изображений оказались женскими.

Что об этом думают эксперты

На самом деле эти результаты не отражают реальности. Каждый третий бизнес в мире принадлежит женщинам.

Ведущие бизнесмены считают, что модели искусственного интеллекта "пронизаны предрассудками", которые далеки от положения дел в современном обществе. Они призвали к усилению мер по борьбе против этих предрассудков.

К слову, OpenAI, владелец ChatGPT, - не первый технологический гигант, подвергшийся критике из-за старомодных стереотипов.

В этом месяце в создании "расистского" генератора изображений из ИИ также обвинили компанию Meta. Пользователи сервиса вдруг обнаружили, что он не представляет себе азиатского мужчину рядом с белой женщиной.

Дерек Маккензи, исполнительный директор компании Investigo, специализирующейся на подборе персоналаотметил: "Хотя способность генеративного ИИ обрабатывать огромные объемы информации, бесспорно, потенциально может облегчить нашу жизнь, мы не можем избежать того факта, что многие модели обучения пронизаны предрассудками, основанными на предвзятости".

Рухи Хан, исследовательница искусственного интеллекта и феминизма в Лондонской школе экономики, объяснила, что ChatGPT "возник в патриархальном обществе, концептуализировался и разрабатывался в основном мужчинами, имевшими набор определенных предубеждений, а также учился на данных, которые тоже были ошибочными по своей природе". Модели искусственного интеллекта, такие как ChatGPT, увековечивают патриархальные нормы, просто копируя их, добавила эксперт.

В ответ на эти обвинения на сайте OpenAI появилась публикация, в которой компания признала, что ее чат-бот действительно "не свободен от предубеждений и стереотипов". Это серьезная проблема, которую специалисты OpenAI в дальнейшем будут активно преодолевать. Также компания призвала пользователей тщательно проверять контент, который создает чат-бот.

"Мы постоянно совершенствуем наши модели, чтобы уменьшить предвзятость и вредные последствия", - говорилось в статье.

Фото: pixabay.com